Deepfake เป็นเทคโนโลยีที่ใช้สร้างสื่อสังเคราะห์เพื่อปลอมแปลงลักษณะบุคคลต่าง ๆ ผ่านสื่อวิดีโอ ภาพถ่าย และการบันทึกเสียง โดยใช้ประโยชน์จาก AI ที่ถูกพัฒนาด้วยเทคโนโลยีแบบ "การเรียนรู้เชิงลึก (Deep Learning)" หรือโปรแกรมฝึกสอนของ AI ที่เลียนแบบการทำงานของโครงข่ายประสาทของมนุษย์ (Neural Network) ทำให้ Deepfake มีความสามารถปลอมบุคคลต่าง ๆ ได้อัตโนมัติและแนบเนียน จากสิ่งที่ได้เรียนรู้ใบหน้าและเสียงของคนเหล่านั้น

Deepfake มาจากการผสมคำว่า Deep Learning และคำว่า Fake ที่แปลว่า ปลอม

เทคโนโลยีเป็นดาบสองคม และจำนวนไม่น้อยมีผู้นำไปใช้ไปในทางที่ไม่สร้างสรรค์ ซึ่งในหลาย ๆ ประเทศ เช่น เกาหลีใต้ พบว่า มีการนำเทคโนโลยี Deepfake สร้างภาพโป๊เปลือย หรือ ลบเสื้อผ้าของหญิงสาว โดยทำผ่านกลุ่ม Telegram และส่งต่อกันเป็นทอด ๆ ซึ่งผู้ก่อเหตุเป็นเพียงนักศึกษามหาวิทยาลัย ข้อมูลที่น่าตกใจ คือ ผู้ก่อเหตุเป็นนักศึกษามหาวิทยาลัยแห่งชาติโซล (Seoul National University) หรือ โซลแด มหาวิทยาลัยอันดับที่ 1 ของประเทศ

ที่มา: Wikimedia

ที่มา: Wikimedia

รายงานจากกระทรวงศึกษาธิการแห่งเกาหลีใต้ ระบุว่า ในปี 2024 มีเหยื่อที่ได้รับผลกระทบจาก Deepfake มากถึง 833 คน เกิดเหตุขึ้นกับบุคลากร ในโรงเรียน 504 คดี ผู้เสียหายเป็นนักเรียนหญิง 799 คน นักเรียนหญิงระดับมัธยมศึกษาตอนปลายมากสุด จำนวน 279 คน และครูผู้หญิงอีก 31 คน

ประเด็นที่น่าประหลาดใจ เพราะ Deepfake ถูกใช้งานที่ต่างออกไป หลังเมื่อไม่นานมานี้ จากที่เคยใช้งานในเชิงหลอกลวง สร้างข่าวปลอม หรือโฆษณาชวนเชื่อ โดยมีการใช้ Deepfake เปลี่ยนเสียงเป็น “โจ ไบเดน” โทรศัพท์ไปตามบ้านเรือนเพื่อเชิญชวนให้เลือกพรรคเดโมแครต การเปลี่ยนหน้า “โดนัลด์ ทรัมป์” ให้พูดจาเสีย ๆ หาย ๆ และใช้เพื่อหลอกหลวงเงินลงทุน โดยเปลี่ยนหน้าเป็นกลุ่มทุนเพื่อเข้าประชุมแทนกลุ่มทุนจริง ๆ

และนำมาสู่การใช้งานที่เกี่ยวข้องกับสื่อลามกอนาจารได้ และสิ่งนี้อาจจะเป็นภยันตรายจาก Generative AI ที่ใกล้ตัวประชาชนเพิ่มมากขึ้น โดยเฉพาะในกลุ่มผู้หญิง

“ล้อเล่น สู่ หลอกลวง” Deepfake ใช้ AI สลับใบหน้า

Deepfake เป็น Generative AI ประเภทหนึ่งที่ใช้สำหรับการสลับหน้าของบุคคลหนึ่งกับอีกบุคคลหนึ่ง ทั้งในรูปแบบภาพนิ่งและวิดีโอ ส่วนใหญ่แล้ว มักใช้สลับหน้าของผู้ใช้งานกับบุคคลที่มีชื่อเสียง อาทิ ผู้ใช้งานสลับหน้ากับ อีลอน มัสค์ รูปภาพที่ออกมาก็จะเป็นร่างกาย ทรงผม และช่วงใบหู ของอีลอน มัสค์ แต่ช่วงใบหน้าเป็นของผู้ใช้งาน

ในช่วงแรก เป้าหมายหลักของผู้ใช้งาน Deepfake เพื่อความสนุกสนาน ใช้หยอกล้อกันภายในกลุ่มเล็ก ๆ โดย ผู้ใช้งานอาจจะนำรูปเพื่อนไปสลับหน้ากับภาพที่ทำท่าทางแปลก ๆ ตลกสนุกสนาน แต่ต่อมาเมื่อ Deepfake เริ่มพัฒนาให้มีประสิทธิภาพมากขึ้น เช่น สามารถจับการเคลื่อนไหวริมฝีปากได้เสถียรขึ้น สามารถลงเสียงตามใจผู้ใช้งานได้ หรือสร้างการเคลื่อนไหวได้ตามความต้องการ จากเคยใช้เพื่อความสนุก กลับเปลี่ยนไปอย่างสิ้นเชิง

การหลอกลวงทางการเมือง เป็นสิ่งแรก ๆ ที่ผู้ใช้ Deepfake กระทำ จากสถิติของ Sumsub Expert Roundtable: The Top KYC Trends Coming in 2024 ชี้ให้เห็นว่า อัตราการเพิ่มขึ้นของการใช้ Deepfake เพิ่มขึ้นราว ๆ 10 เท่าในแต่ละปี โดยภูมิภาคอเมริกาเหนือมีอัตราเพิ่มขึ้นมากที่สุดที่ร้อยละ 1,740 รองลงมา คือ เอเชียแปซิฟิกที่อัตราร้อยละ 1,530

พาเวล โกลด์แมน-เคเลย์ดิน หัวหน้างาน AI และ Machine Learning แห่ง Sumhub มองว่า Deepfake มีการพัฒนาให้สมจริงเพิ่มขึ้น ในช่วงไม่กี่ปีที่ผ่านมา และยังคงพัฒนารูปแบบใหม่ ๆ พร้อมๆกับการฉ้อโกงและหลอกลวงที่ตามมา ทุกฝ่ายต้องเฝ้าระวังการหลอกลวงที่มากับสิ่งนี้อย่างเข้มงวด ไม่เพียงแต่ตรวจจับ แต่ต้องใช้วิธีการป้องปรามในหลาย ๆ ชั้น

หมายความว่า การใช้งาน Deepfake เพื่อหลอกลวงและสร้างข่าวเท็จ ย่อมเพิ่มขึ้นเช่นกัน และการเผยแพร่ในโลกออนไลน์ยิ่งทำได้ง่าย เนื่องจากวิธีการเสพสื่อของผู้ใช้งานส่วนใหญ่ มันจะเสพ แต่สิ่งที่ตนต้องการ หรือ Echo Chamber ไม่สนการเสพสื่ออย่างรอบด้านและกลั่นกรองข้อเท็จจริง บางที ไม่ได้สนใจว่า สิ่งนั้นจริงหรือไม่ หากไม่ถูกใจก็พร้อมเชื่อว่าเท็จ ทำให้การใช้ Deepfake ในเชิงลบลักษณะนี้ มีผู้ให้การสนับสนุนจำนวนมาก

ข้อมูลของ Deloitte ประมาณการณ์มูลค่าความเสียหายจากการใช้ Deepfake เพื่อหลอกลวงและสร้างข่าวเท็จในสหรัฐอเมริกา มีมากถึง 40,000 ล้านดอลลาร์สหรัฐ ภายในปี 2027 โดยมีเป้าหมายหลักสำคัญอยู่ที่ “วงการการเงินและเทคโนโลยี” และมีอัตราเพิ่มขึ้นจากปี 2023 ร้อยละ 700 ขณะที่สถิติของ Treasurers เผยว่า มีจำนวน CEO ที่ได้รับผลกระทบอย่างน้อย 400 คนต่อวัน

รายงานของ Regula ระบุว่า ส่วนใหญ่การหลอกลวงในระดับผู้บริหารมักจะเป็นการสร้างอัตลักษณ์เทียม (Synthetic Identities Fraud) เช่น การสลับหน้าเพื่อหลอกเข้าร่วมประชุมออนไลน์ให้ลงทุนหรือการเปลี่ยนข้อมูลทะเบียนราษฎร์ปลอม ๆ เพื่อทำธุรกรรม กว่าร้อยละ 46 ของกลุ่มตัวอย่าง เคยประสบกับเหตุการณ์นี้ และกว่าร้อยละ 88 รู้สึกว่าสิ่งนี้เป็นภัยคุกคามอย่างแท้จริง

Deepfake ภัยมืดคุกคาม-ผู้หญิง-นักการเมือง

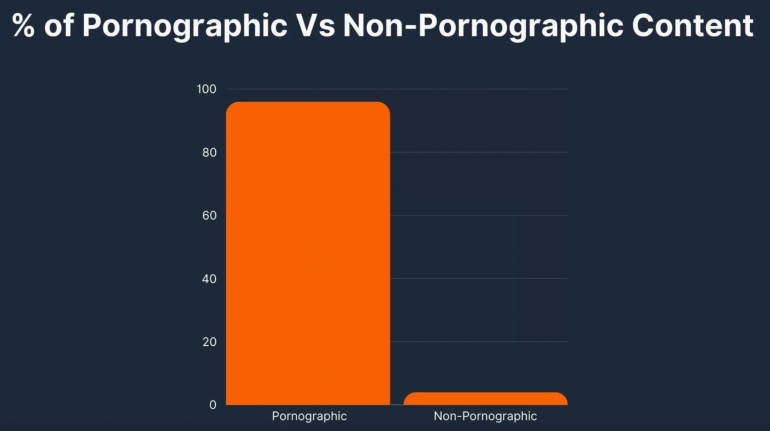

แม้ Deepfake จะสร้างความอันตรายด้วยการหลอกลวงและสร้างข่าวเท็จ โดยมีอัตราการเพิ่มขึ้นประมาณ 6.52 เท่า แต่จากสถิติของรายงาน The State of Deepfakes พบว่า จากจำนวนการใช้งาน Deepfake ทั้งหมดในสหรัฐอเมริกา อัตรากว่าร้อยละ 96 เป็นการใช้งานเพื่อสร้าง “สื่อลามกอนาจาร” (ส่วนอีกร้อยละ 4 เป็นการสร้างสิ่งอื่น ๆ อาทิ ข่าวเท็จ สื่อการศึกษา)

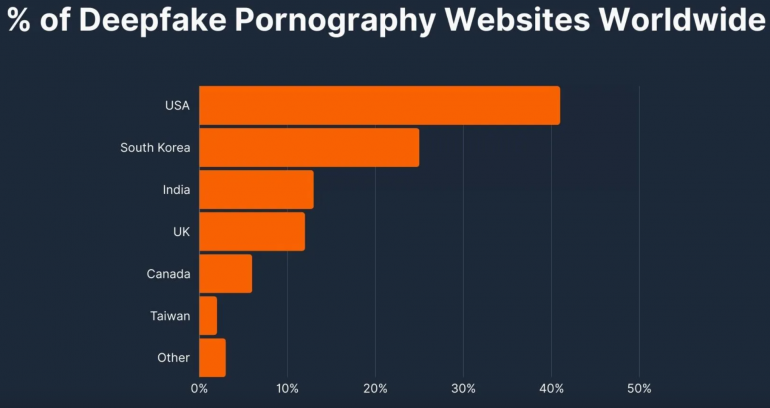

และเว็บไซต์ที่เปิดให้ใช้งาน Deepfake ในลักษณะนี้ ปรากฏที่สหรัฐอเมริการ้อยละ 41 รองลงมา คือ เกาหลีใต้ร้อยละ 25 และอินเดียร้อยละ 13 ตามลำดับ

ที่มา: The State of Deepfakes

ที่มา: The State of Deepfakes

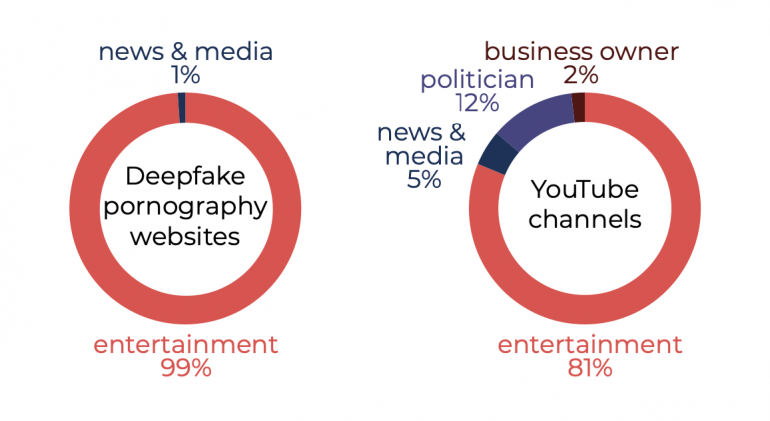

โดยเหยื่อทั้งหมดในการใช้ Deepfake สร้างสื่อลามกอนาจารในเว็บไซต์เป็นผู้หญิง (อัตราร้อยละ 100) เมื่อเทียบกับการใช้ Deepfake สร้างสิ่งอื่น ๆ นอกเหนือจากนี้เหยื่อจะเป็นผู้ชายมากกว่า (ผู้ชายร้อยละ 61 ผู้หญิงร้อยละ 39) และเหยื่อผู้หญิงส่วนใหญ่เป็นนักแสดงหรือนักร้อง ในอัตราร้อยละ 99 อีกร้อยละ 1

ที่เหลือส่วนใหญ่เป็นผู้ประกาศข่าวหรืออินฟลูเอนเซอร์ ส่วนในช่องทาง YouTube และน่าตกใจว่า “นักการเมือง” ได้รับผลกระทบถึงร้อยละ 12

ที่มา: The State of Deepfakes

ที่มา: The State of Deepfakes

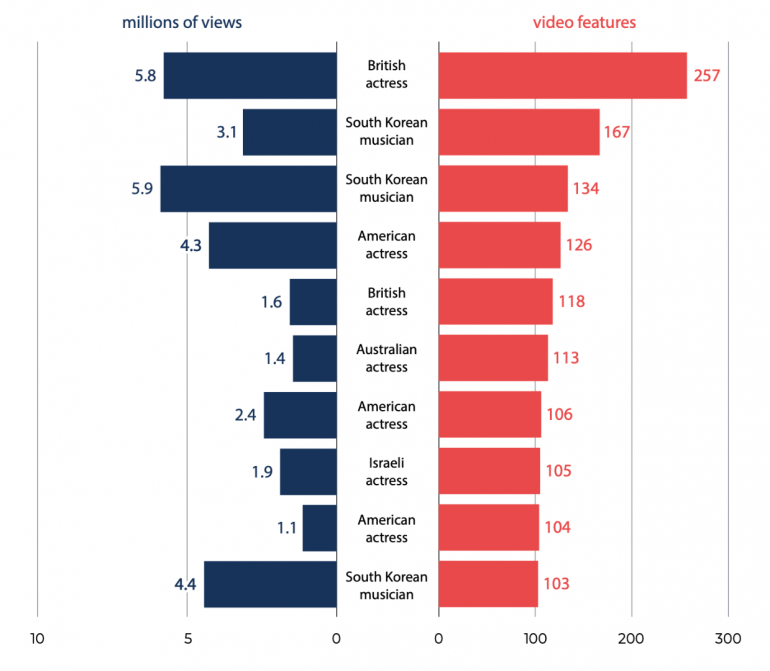

ขณะที่การใช้ Deepfake เพื่อสร้างสื่อลามกต่อนักแสดงหญิง ชาวสหราชอาณาจักรมีจำนวนใน YouTube มากที่สุดในปี 2019 ที่จำนวน 257 คลิป ส่วนการใช้ Deepfake สร้างสื่อลามกต่อนักร้องชาวเกาหลีมีจำนวนการรับชมใน YouTube มากที่สุดจำนวน 5.9 ล้านวิว ถือว่ามากที่สุดในปี 2019

ที่มา: The State of Deepfakes

ที่มา: The State of Deepfakes

จากสถิติของ Security Hero ที่ทำการสำรวจความเห็นของผู้ชายชาวอเมริกันจำนวน 1,522 คน พบว่า ร้อยละ 48 เคยใช้งาน Deepfake สร้างสื่อลามก จำนวนนี้กว่าร้อยละ 57 ใช้งานเพื่อทดสอบความสามารถในการสร้างสื่อลามกและภาพโป๊เปลือยว่ามีความแนบเนียนมากน้อยเพียงไร กว่าร้อยละ 48 ใช้งานเพื่อสร้างภาพโป๊เปลือยของนักแสดงหรือผู้หญิงที่ตนชื่นชอบ และกว่าร้อยละ 36 ใช้งานเพื่อสร้างสื่อลามกที่ไม่เคยได้เสพจากวงการภาพยนตร์ผู้ใหญ่ในท้องตลาดมาก่อน

ที่มา: The State of Deepfakes

ที่มา: The State of Deepfakes

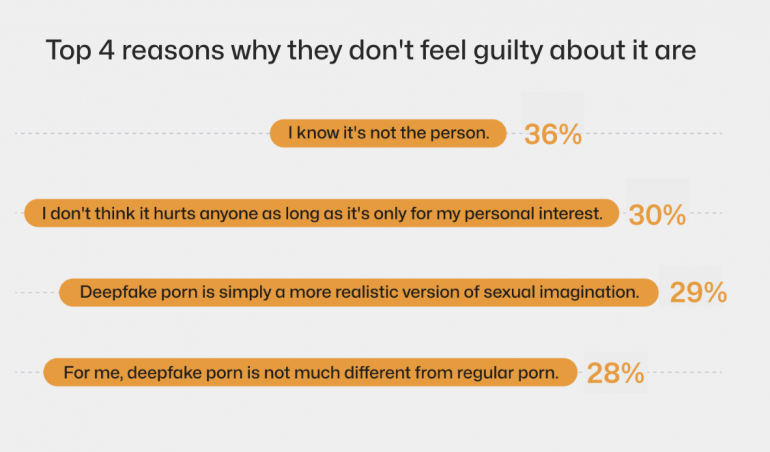

และที่น่าวิตก คือ กว่าร้อยละ 74 ของกลุ่มตัวอย่างไม่รู้สึกละอายแก่ใจในการใช้งาน Deepfake สร้างภาพโป๊เปลือย โดยเหตุผลหลัก ๆ จากจำนวนนี้ ร้อยละ 36 ระบุว่า ภาพโป๊เปลือยที่ Deepfake สร้างขึ้นมาไม่ใช่ของจริง ร้อยละ 30 กล่าวว่า ไม่สนใจว่าใครจะได้รับผลกระทบ สนใจแต่ความต้องการของตนเอง ร้อยละ 29 กล่าวว่า Deepfake ช่วยให้ภาพโป๊เปลือยในจินตนาการของตนเองเข้าใกล้ความจริงไปอีกขั้น และร้อยละ 28 Deepfake ไม่แตกต่างจากภาพยนตร์ผู้ใหญ่หรือรูปลับที่หลุดออกมา

นอกจากนี้ยังพบอีกว่า กลุ่มตัวอย่างกว่าร้อยละ 20 ใช้งาน Deepfake เพื่อปรับเปลี่ยนเนื้อเรื่องและองค์ประกอบของภาพยนตร์ผู้ใหญ่ตามท้องตลาดให้เป็นไปตามที่พวกเขาชื่นชอบ และกว่าร้อยละ 20 ทุ่มเทเวลาเพื่อเรียนรู้การใช้งานในการสร้างสื่อลามกที่ทรงประสิทธิภาพมากยิ่งขึ้น

ที่มา: Security Hero

ที่มา: Security Hero

“กฎหมายไทย” มาตรการเฝ้าระวัง Deepfake

อันตรายของ Deepfake ที่พัฒนาการจากการหลอกลวงและสร้างข่าวเท็จ มาสู่การสร้างสื่อลามกโป๊เปลือย และนำไปเผยแพร่ ถือเป็นสิ่งผิดกฎหมาย จำเป็นต้องมีมาตรการกำกับ ควบคุม เฝ้าระวัง หรือลงโทษ แต่กฎหมายที่บังคับใช้กลับตามไม่ทันความเปลี่ยนแปลงของเทคโนโลยีดังกล่าว

ในประเทศไทย มีการบังคับใช้ พ.ร.บ.การกระทำความผิดเกี่ยวกับความผิดทางคอมพิวเตอร์ มาตรา 16 ว่าด้วย “ผู้ใดนําเข้าสู่ระบบคอมพิวเตอร์ที่ประชาชนทั่วไปอาจเข้าถึงได้ซึ่งข้อมูลคอมพิวเตอร์ ที่ปรากฏเป็นภาพของผู้อื่น และภาพนั้นเป็นภาพที่เกิดจากการสร้างขึ้น ตัดต่อ เติม หรือดัดแปลง ด้วยวิธีการทางอิเล็กทรอนิกส์หรือวิธีการอื่นใด โดยประการที่น่าจะทําให้ผู้อื่นนั้นเสียชื่อเสียง ถูกดูหมิ่น ถูกเกลียดชัง หรือได้รับความอับอาย ต้องระวางโทษจําคุกไม่เกินสามปี และปรับไม่เกินสองแสนบาท”

โดยมีบทลงโทษและขอบข่ายการกระทำผิดครอบคลุมถึงการใช้ Deepfake ในการสร้างภาพลามกอนาจาร แต่สิ่งที่เป็นปัญหา คือ ประเทศไทยไม่ได้ควบคุม ระบบการทำงานหรือโครงข่าย Deepfake แต่พยายามควบคุม เนื้อหาสาระ (Contents) ที่ Deepfake สร้างขึ้นมา และต่อให้สามารถเอาผิดผู้สร้างสื่อลามกอนาจรด้วย Deepfake ได้ แต่ Deepfake ที่ใช้สร้างสื่อดังกล่าวยังคงอยู่

หรือแม้แต่ในสหรัฐอเมริกา ประเทศที่มีการใช้งาน Deepfake ในทางมิชอบมากที่สุดในโลก ยังประสบกับปัญหาดังกล่าว โดยผู้พิพากษาส่วนกลางสหรัฐ อเมริกา (Federal Judge) ยับยั้งกฎหมายการควบคุมและเปิดเผยการใช้ Deepfake โดยให้เหตุผลสำคัญว่า แม้สิ่งดังกล่าวจะคุกคามและสร้างความหวาดวิตกต่อประชาชน แต่สหรัฐอเมริกา ในนาม “ประชาธิป ไตยและเสรีภาพในการแสดงออกทางวาจา” ทำให้ไม่สามารถที่จะยับยั้งหรือสั่งห้าม Deepfake ได้

พล.อ.ต. อมร ชมเชย เลขาธิการสำนักงานคณะกรรมการการรักษาความมั่นคงปลอดภัยไซเบอร์แห่งชาติ (สกมช.) เปิดเผยว่า กฎหมายสำหรับป้องปรามการใช้งาน Deepfake ในทางมิชอบในประเทศไทยยังไม่เข้มข้นเท่ากับต่างประเทศ โดยเฉพาะสหภาพยุโรปที่ออกกฎหมายควบคุม AI (AI Act) ออกมา แต่ลำพัง พ.ร.บ. คอมพิวเตอร์ที่มีอยู่ก็สามารถฟ้องร้องเอาผิดได้

ที่มา: NCSA Thailand

ที่มา: NCSA Thailand

เลขาฯ สกมช. ระบุว่า ปัญหาเราอาจจะไม่เท่าต่างประเทศ ซึ่งค่อนข้างจะมีมากของเรายังเป็นการตัดต่อธรรมดา หรือแม้แต่แอบถ่าย ตอนนี้ ความสำคัญ คือ จะป้องกันตนเองอย่างไร สังเกตความผิดปกติ การตรวจจับหรือเฝ้าระวัง

ทุกคนต้องสังเกตเองก่อนว่า สิ่งที่เห็นจะนำไปสู่ผลกระทบอย่างไรได้บ้าง ปัจจุบันการควบคุมยังค่อนข้างยากอยู่

“สิ่งที่เป็นห่วงอยู่ เพราะรายการหนึ่งในช่องดิจิทัลใช้ Deepfake เป็นประจำทำได้สมจริงมากยิ่งขึ้น แต่อาจจะอยู่ในสภาพแวดล้อมที่ต้อง Set Up เป็นมืออาชีพ แต่อนาคตอาจมีการใช้งานได้ทั่วไป แม้ตอนนี้จะยังไม่สมบูรณ์ สลับหน้าไม่แนบเนียน รูปปากไม่ตรงกับเสียง ในอนาคตอาจจะแนบเนียนกว่านี้” พล.อ.ต. อมร ระบุ

ทั้งนี้ พล.อ.ต. อมร ไม่เห็นด้วยกับการแบนการใช้งาน Deepfake เพื่อแก้ไขปัญหา เพราะจะทำให้ไทยเสียโอกาสในการแข่งขันกับนานาประเทศ ซึ่งเราต้องตามให้ทันโลก ต้องดูที่วัตถุประสงค์ของการใช้งานว่าเพื่ออะไร หากใช้งานในทางที่ผิดก็ว่าไปตามกฎหมาย เป็นคนละส่วนกันกับตัว Deepfake

มุมหนึ่งเป็นความก้าวหน้าทางด้าน AI เพราะมีการใช้ในด้านความบันเทิง สร้างภาพยนตร์ อะไรต่าง ๆ ที่ไม่มีผลกระทบในเชิงลบ เร็วไปที่จะออกกฎหมายควบคุม ประเทศที่ควบคุมมักจะหมิ่นเหม่ในเรื่องการริดรอนสิทธิและเสรีภาพ ไปขัดขวางความก้าวหน้า โอกาสของประเทศที่จะได้รับจาก AI คงไม่ได้ไปแบน เพื่อหยุดความก้าวหน้าด้านนี้

ที่มา: NCSA Thailand

ที่มา: NCSA Thailand

พล.อ.ต. อมร เสนอว่า ประชาชนทั่วไปควรตามให้ทันเทคโนโลยีนี้มากกว่า และขณะนี้ สกมช. ก็เข้าไปมีบทบาทในการสร้างการรับรู้และตระหนักต่ออันตรายดังกล่าว รวมทั้งการสร้างเกมกระดานเพื่อการเรียนรู้ของเด็กวัย 3 ขวบ ให้เกิดความเข้าใจอันตรายที่จะเกิดขึ้นจาก Deepfake

หรือกลุ่มผู้สูงอายุที่มักจะตกเป็นเหยื่อของเทคโนโลยีได้ง่าย สกมช. ได้ร่วมมือกับหน่วยงานทางสังคมต่าง ๆ เพื่อให้ความรู้กับกลุ่มเหล่านี้ เพื่อสร้างให้ผู้ใช้งาน Deepfake ในทางมิชอบไม่รู้สึกคุ้มค่าที่จะทำ เพราะประชาชนรู้ทันหมดแล้ว

แนะนำว่า ต้องตั้งสติดี ๆ อะไรก็ตามที่เราพบเจอในโลกโซเชียล ต้องตั้งข้อสังเกต ต้องมั่นใจมากกว่าที่หูได้ยิน หรือที่ตาเห็น

อ่านข่าว:

เพื่อนร่วมอาลัย "ครูสาวน้อย" เผยเป็นคนดี-มีน้ำใจ

1 ปีแห่งสงคราม "เนทันยาฮู" ยังกร้าวไม่เลิกโจมตี-สู้จนกว่าชนะ